Жар ЦОД не ломит. Как устроено охлаждение самого горячего места УрФУ?

18:09, 11 июля 2021

Когда-нибудь держали ноутбук на коленях хотя бы полчаса? Если да, то сами ощущали, какими горячими могут быть фильмы. А теперь представьте себе, что вы находитесь в помещении, где собрано оборудование, отвечающее за вычислительные мощности всего Университета. Чувствуете, как повышается температура? Но при этом, если вы попадете в наш ЦОД, то не испытаете никакого дискомфорта. Мы решили узнать, как при такой температуре на улице, от которой плавятся мороженое, асфальт и иногда мозги, комфортно работает центр обработки данных. Причем, даже в такую жаркую (во всех смыслах) пору, как приемная кампания.

Напоминаем, что такое ЦОД

ЦОД - это инженерно-организационное решение, главное назначение которого – создание инфраструктуры для хранения и обработки данных с высокой производительностью и хорошей отказоустойчивостью. Звучит, как выдержка из учебника «Как рассказать о ЦОД и всех усыпить». Если объяснять значение в более узком, бытовом плане, то это помещение, в котором расположено специальное оборудование. Опять же, для хранения и обработки данных.

ЦОД УРФУ – это отдельное встроенное помещение площадью 84 квадратных метра на 13 этаже учебного корпуса на Софьи Ковалевской, 5, в здании бывшего «теплофака». Внутри находится специальное оборудование для хранения данных и обеспечения их безопасности (оборудование серверных сетевых систем, систем обработки и хранения данных, систем корпоративных сервисов и приложений). Оборудование на телекоммуникационных шкафах, которые позволяют разместить более 700 килограммов всего необходимого. Окончательно ЦОД переехал в этом помещение три года назад.

Чем ЦОД отличается от простой серверной?

Размерами и специальной инженерной инфраструктурой, которая направлена на сохранность данных и их бесперебойное использование. Здесь у нас находится:

- Система электроснабжения с двумя независимыми источниками питания. Это сделано для подстраховки и создания резерва энергоснабжения на случаи ЧП.

- Система автоматического газового пожаротушения. Системы ЦОД - не рукописи, поэтому могут и загореться. Чтобы этого не произошло, осуществляется постоянный контроль за появлением дыма в защищаемых помещениях. При пожаре подается сигнал в единую систему охранно-пожарной сигнализации УрФУ и осуществляется автоматический пуск системы. Такое пожаротушение лишает огонь «дыхания», то есть кислорода, замещая его другими газами.

- Система кондиционирования и вентиляции технологических помещений. Данные - очень горячие. Точнее, оборудование, на котором они хранятся, сильно нагревается в процессе работы, и излишки тепла нужно удалять.

Откуда в ЦОДе столько тепла?

Все знают, что в серверных и ЦОДах – шумно (обычно это шумят кулеры). А еще там может быть очень жарко. Каким бы удивительным не казалось, но почти все вычисления, которыми занимаются процессоры, выделяют очень много тепла. Все дело в транзисторах. По сути, они представляют собой переключатели с электрическим управлением, которые включаются и выключаются миллиарды раз в секунду. И каждый из них, при своей работе, выделяет немного тепла, преобразуя электрическую энергию в тепловую. А теперь факт: в процессорах Ryzen Threadripper 3960X и 3970X «упакованы» целых 3,8 миллиарда транзисторов. Просто представьте, сколько тепла они выделяют! Естественно, его нужно отводить.

Чем нагрев опасен для ЦОДа?

По нашим скромным подсчетам, оборудование, что сегодня стоит в ЦОДе, выделяет столько же тепла, как и 30 обогревателей разом. При этом площадь помещения не сказать, что с «Экспо». И вот представьте, что все это тепло остается внутри помещения, и нагревает, нагревает, нагревает воздух. Что случится?

Перегрев процессоров, которые обеспечивают обработку данных, ведет, в лучшем случае, к замедлению работы. Если просто, то в процессорах встроена функция термической защиты процессора – Thermal throttling (троттлинг), она срабатывает в случае, если не обеспечено достаточного охлаждения. Установленные в чипе термодатчики следят за температурой кристалла, и, если она повышается выше допущенной, процессор автоматически понижает свою рабочую частоту, снижая уровень тепловыделения. Естественно, падает производительность.

В худшем случае, перегрев способен полностью вывести процессоры из строя. Такая же история с жесткими дисками, на которых хранятся данные. При температуре выше 30 градусов по Цельсию, внутри начитаются необратимые последствия, и резко снижается срок службы оборудования. А там и до отказа системы недалеко. Греется и оперативная память, и блоки питания. Страшно? Да на самом деле нет, потому что у нас стоит профессиональная система кондиционирования воздуха.

Как устроено охлаждение в ЦОД УрФУ?

Сейчас в ЦОД работает 6 промышленных прецизионных профессиональных кондиционера. Не боимся слова «прецизионные»: это кондиционеры, которые строго соблюдают климатический режим в помещении. Работают круглосуточно и бесперебойно на протяжении долгого периода времени, поддерживают постоянную температуру и влажность, умеют очищать воздух от пыли. Раз в полгода проходят плановое обслуживание и при правильном и своевременном ТО могут работать очень-очень долго. Кстати, кондиционеры – это не система вентиляции, как думают многие. Они не обеспечивают приток свежего воздуха, а работают с тем, что есть внутри помещения.

Когда бы вы не прочитали про них – в выходной, в отпуске или ночью, они все равно работают, дружно и слаженно (хотя, их ресурса хватает даже с запасом). Устройства организуют постоянную температуру 22 градуса в так называемом холодном коридоре. А есть еще и горячий. Знаете разницу?

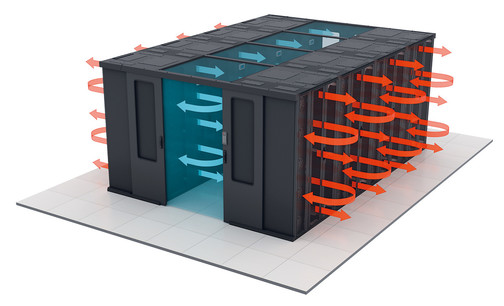

Да, вы правильно предположили – в холодный коридор кондиционер «сбрасывает» охлажденный воздух. Делает он это, задувая его под пол с выделенным пространством. Оттуда, через отверстия, он попадает в серверные стойки, нагревается, выходит наружу в горячий коридор, где его подхватывают кондиционеры, охлаждают и все по-новому. Это если схематично и просто.

Когда находишься внутри, словно бы плаваешь в уральском озере. Вот теплый поток, а вот – холоднее. Стоишь в тепле, руку протянул чуть в сторону – прохладно.

Такой вариант охлаждения оптимален для нашего ЦОДа. Да, есть и другие схемы. Например, водное охлаждение, признаваемое многими более эффективным для мощных ЦОДов. Но если использовать так называемую «сухую» воду, это сильно удорожает процесс, а если обычную, «мокрую», то небезопасно уже для самих серверов, если что-то пойдет не так – при аварии жидкость просто зальет серверы. К тому же, при установке водного охлаждения, важна унификация в ЦОД: один теплоноситель, один диаметр трубы, одна скорость циркуляции. ЦОД УрФУ – универсальный, когда любое подразделение, грубо говоря, может принести туда что-то и установить, и соблюдать унификацию нет смысла. В таком случае воздушное охлаждение оптимально по соотношению «цена-качество».

Из-за жары и приемной кампании бывают сложности?

На самом деле, самая жаркая пора для всего Университета не так и критична для ЦОДа. Да, у приемной комиссии и Дирекции много работы, но для инфраструктуры и вычислительной техники куда большую нагрузку дают системы электронного обучения. Там и «тяжелый» контент, и интенсивность обращения выше. Вот где жара! Но ресурсов ЦОДа хватает с лихвой – специально строили и оснащали так, чтобы было достаточно для работы систем Цифрового университета.

Что же касается жары – у ЦОД тоже проблем нет, мощностей кондиционеров хватает с запасом. Этим летом была интересная задача по охлаждению крупного сетевого узла, когда холодный воздух перекачивали из одной серверной в другую с помощью…дымососа. Да, оригинально и не совсем «АйТи», но нашли выход из сложившейся ситуации так, что никто не заметил проблем с нагревом оборудования.

Не только охлаждение

Кстати, для серверов важно не только охлаждение, они любят влажность. Ну как, любят – она им необходима. Понятно, что дай кондиционеру волю, он всю влагу из воздуха переведет в конденсат, сольет ее в канализацию и доведет влажность до 10%. В сухом воздухе есть гигантские риски образования статического электричества (вероятность пожара) и от него рассыхается (просто разваливается на глазах) пластик. Для этого влажность в ЦОДе поддерживается на уровне 50%.

А еще вентиляция обеспечивает давление воздуха в ЦОДе больше, чем снаружи. Это нужно для того, чтобы при открытии двери в центр, воздух выходил из него, а не попадал внутрь, принося с собой дополнительную температуру и пыль.

Так что ЦОД и наши данные защищены со всех сторон. Лето, продолжай!

-

Категории

Новости Дирекции ИТЛайфхак